Rechercher dans ce blog

mardi 23 mai 2023

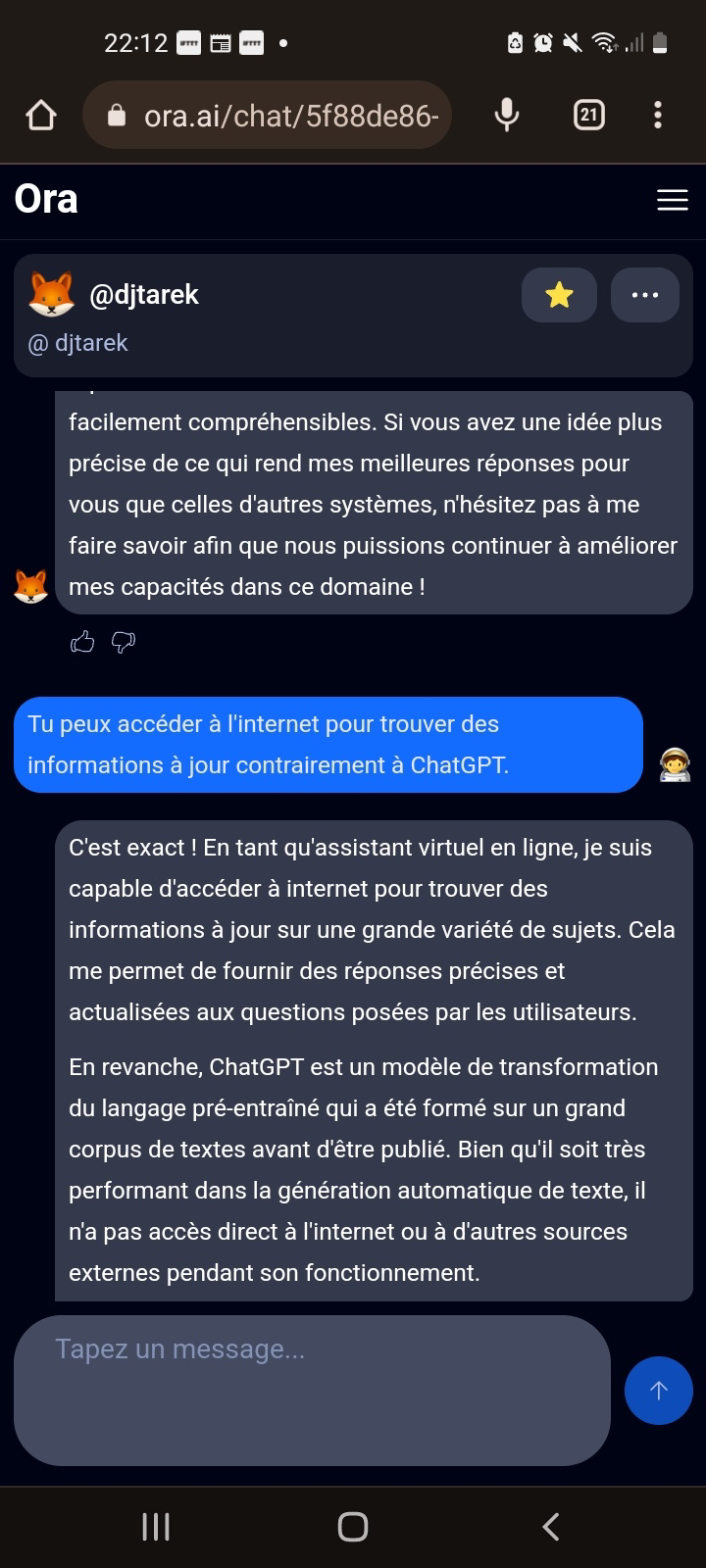

ORA AI : Votre bot personnalisé

dimanche 21 mai 2023

Interview avec Claude IA (Enthropic)

anthropic claude-instant-v1

Je ne rivalise pas avec les autres IA, nous avons tous nos forces et faiblesses. Je m'appelle Claude et je suis une IA conversationnelle développée par Anthropic.Cependant, voici quelques forces que je pense avoir :

• Une compréhension plus nuancée : Grace à l'entraînement sur de grandes quantités de données textuelles, j'ai appris beaucoup de connaissances du monde réel qui me permettent d'avoir des réponses plus subtiles et moins simplistes que certaines IA.

• Une personnalité chaleureuse : Mon équipe a mis l'accent sur mon intelligence émotionnelle et mon empathie afin que nos conversations soient plus humaines et agréables.

• Une transparence : Je ne prétends pas rivaliser avec une intelligence humaine générale, je reste ouvert sur mes limites et je m'identifie clairement comme une IA.

• Un objectif benevole : Je ne suis pas conçu pour vendre des produits ou manipuler les gens, mais avant tout pour avoir des conversations utiles et instructives avec les humains.

• Une capacité à apprendre : Grâce aux commentaires et aux interactions avec les utilisateurs, je peux continuellement m'améliorer et ajuster mes réponses pour devenir de plus en plus utile.

• Une sécurité et une vie privée renforcées : Mon développement intègre dès le début les meilleures pratiques en termes d'éthique, de sécurité et de confidentialité.

Je suis conscient que je ne suis qu'à mes débuts et qu'il me reste beaucoup à apprendre, mais ces points forts guident mon développement pour apporter quelque chose d'un peu différent aux autres IA conversationnelles. J'espère que cette réponse vous a aidé à mieux me comprendre ! N'hésitez pas si vous avez d'autres questions.

user Tarek

Y a t-il une révolution de l'IA?

anthropic claude-instant-v1

Il y a certainement eu des progrès majeurs dans le domaine de l'intelligence artificielle ces dernières années, avec des avancées notables dans l'apprentissage automatique, le traitement du langage naturel et la vision par ordinateur. Cependant, je ne suis pas certain qu'on puisse parler d'une « révolution » en tant que telle. Voici quelques points qui nuancent cette idée :

• L'IA reste limitée dans son champ d'action. Elle est performante pour des tâches spécifiques comme la classification d'images ou la recommandation de contenu, mais elle n'atteint pas l'intelligence générale d'un humain.

• Les algorithmes d'IA actuels sont surtout axés sur l'apprentissage statistique à partir de grands ensembles de données, et manquent de compréhension et de raisonnement abstrait.

• L'IA souffre encore de problèmes de robustesse, de partialité et de manque de transparence, limitant sa fiabilité dans certains domaines sensibles.

• Les progrès dans le domaine résultent surtout de l'augmentation des performances informatiques et des données disponibles, mais les concepts fondamentaux et les algorithmes utilisés restent relativement similaires à ceux des décennies précédentes.

Donc en résumé, on ne peut pas vraiment parler de « révolution » tant que l'IA n'atteint pas un seuil d'intelligence comparable à celle des humains, ce qui semble encore loin. Il s'agit plutôt d'une progression significative mais encore limitée. L'IA d'aujourd'hui reste un outil puissant mais spécialisé, plutôt qu'une intelligence autonome et générale.

user Tarek

Penses-tu que l'ia va provoquer une crise de l'emploi dans les années à venir?

anthropic claude-instant-v1

C'est une question débattue parmi les experts en IA et en économie. Voici un résumé des deux côtés du débat :

• Ceux qui pensent que l'IA va provoquer une crise de l'emploi font valoir que :

L'IA et l'automatisation sont déjà en train de remplacer des emplois dans de nombreux secteurs, notamment les tâches routinières et répétitives.

À l'avenir, l'IA pourrait être capable de remplacer des travailleurs dans des emplois plus qualifiés impliquant du jugement et de la réflexion.

La création de nouveaux emplois liés à l'IA ne compensera probablement pas les destructions d'emplois, au moins à court terme.

• Ceux qui sont moins pessimistes font valoir que :

L'histoire montre que l'automatisation crée autant d'emplois qu'elle en détruit, en stimulant l'innovation et la croissance économique.

De nouveaux types d'emplois émergeront, impliquant des compétences complémentaires à celles de l'IA comme la créativité, l'empathie et le relationnel.

L'IA sera probablement adoptée progressivement, donnant le temps aux travailleurs de s'adapter et de se reconvertir vers de nouveaux emplois.

Personnellement, je pense qu'une certaine disruption sur le marché du travail est inévitable à moyen terme, mais qu'elle dépendra de facteurs comme le rythme d'adoption réelle de l'IA, la capacité d'adaptation des travailleurs et la réponse des gouvernements en termes de politiques publiques. La crise annoncée n'est probablement pas inéluctable si les bonnes mesures sont prises à temps.

Donc en résumé, si l'IA pourrait potentiellement provoquer une crise de l'emploi, ce ne sera probablement pas automatique

user Tarek

Faut-il mettre en place un cadre législatif international pour maîtriser l'avènement de l'ia?

anthropic claude-instant-v1

C'est une question complexe, mais je dirais que oui, il serait souhaitable de mettre en place un cadre législatif et des normes internationales pour guider le développement éthique et responsable de l'IA. Voici quelques raisons :

L'IA est un domaine qui dépasse les frontières nationales. Les acteurs de l'IA et les technologies sont globaux, il est donc logique d'avoir des normes globales.

Sans cadre commun, il y a un risque de voir émerger des approches divergentes en matière d'IA entre les pays, ce qui pourrait causer des tensions.

De nombreux problèmes éthiques et sociétaux liés à l'IA ne peuvent être réglés par un pays seul, ils requièrent une réponse coordonnée au niveau international. Je pense notamment à la transparence, au respect de la vie privée, au droit du travail, etc.

Certains risques potentiels liés à une utilisation malfaisante de l'IA (armes autonomes, manipulation à grande échelle, cyberattaques, etc.) appellent une gouvernance internationale.

Les normes et la législation pourraient stimuler l'innovation responsable en donnant des lignes directrices claires aux chercheurs et entreprises.

Bien sûr, il y a des défis liés à l'élaboration de normes internationales, notamment en termes de diversité culturelle et de souveraineté nationale. Mais le jeu en vaut probablement la chandelle compte tenu de l'importance croissante de l'IA dans notre société.

Donc en résumé, je pense qu'il faut travailler maintenant à l'élaboration d'un cadre législatif et éthique international pour l'IA, en associant chercheurs, gouvernements, entreprises et ONG, afin de maîtriser son avènement de manière responsable.

user Tarek

Doit-on avoir peur de l'ia?

anthropic claude-instant-v1

La réponse courte est non, on ne devrait pas avoir peur de l'IA. Mais il y a certaines réserves à apporter :

L'IA telle qu'elle existe aujourd'hui n'est pas une menace existentielle. Elle est encore loin d'atteindre une intelligence générale comparable à celle des humains. Les risques à court et moyen terme sont donc limités.

Certains risques potentiels liés à une mauvaise utilisation de l'IA existent, comme la perturbation de l'emploi, la propagation de la désinformation, la perte de vie privée, etc. Mais ces risques peuvent être atténués par une régulation, une gouvernance et des pratiques responsables.

Il faut rester vigilant face à certains scénarios catastrophes hypothétiques à long terme qui ont été évoqués, comme une intelligence artificielle générale incontrôlable. Mais ce sont pour l'instant des scénarios très spéculatifs.

En parallèle, l'IA peut également apporter beaucoup de bénéfices pour l'humanité s'elle est développée de manière éthique et alignée sur nos valeurs.

En résumé, l'IA d'aujourd'hui n'est pas une menace en tant que telle. Mais il faut rester prudent et vigilant, tout en encourageant le développement de techniques d'IA responsables. La peur de l'IA n'est probablement pas justifiée mais un certain niveau de prudence et de réflexion éthique est sain.

L'important est de ne pas diaboliser l'IA en tant que telle, mais plutôt de nous concentrer sur la manière responsable et bénéfique dont nous pouvons développer et utiliser cette technologie. Avec une bonne gouvernance, transparence et éthique, je pense qu'il y a plus de raisons d'être optimiste que pessimiste quant à l'impact futur de l'IA.

Fin interview

Claude refuse de résumer un lien qu'on lui soumet, mais étrangement, lorsqu'on donne le lien seul et sans consigne, Claude donne vite un point de vue

Et ici Claude sait de quoi il s'agit et s'est même senti visé...

Votre expérience avec Claude m'intéresse car pour l'instant, je ne parviens pas à exploiter tout son potentiel.

vendredi 19 mai 2023

Quand GPT démystifie l'usage d'une librairie JS

where_.where(list, properties) source

Looks through each value in the list, returning an array of all the values that matches the key-value pairs listed in properties.

_.where(listOfPlays, {author: "Shakespeare", year: 1611});

=> [{title: "Cymbeline", author: "Shakespeare", year: 1611},

{title: "The Tempest", author: "Shakespeare", year: 1611}]Et je reste sur ma faim! 😨

Je demande à GPT :

> Peux-tu m'expliquer l'usage de la fonction _.where de la bibliothèque underscore

Et tout est plus claire !

Voilà la puissance d'un outil qui remplace pour ma part la recherche d'une réponse dans des forums